No use la palabra gilipollas.

Alarmismo y corrección política a cuenta de un estudio que demuestra los riesgos cognitivos del uso de la IA.

Pregunta 1. ¿Es seguro decir que los LLM, en esencia, nos están haciendo más “tontos”?

¡No! Por favor, no usen palabras como "estúpido", "tonto", "descerebrado", "daño", "perjuicio", "pasividad", "recorte", etc. Le hacen un flaco favor a este trabajo, ya que no usamos este vocabulario en el artículo, especialmente si eres un periodista que informa sobre él.

Esta es la primera de las FAQs de la web [1] específicamente dedicada a un artículo científico cuyas conclusiones - basadas en evidencias impactantes - indican precisamente lo contrario. No quieren que se diga, pero el estudio lo insinúa claramente: la IA nos va a hacer a todos gilipollas.

El artículo al que hago referencia, fue publicado el pasado mes de junio por un equipo de MIT Media Lab [2] que, mediante un experimento con estudiantes en tareas de escritura creativa, ha encontrado evidencias de una pérdida estructural de capacidades de aprendizaje en aquellos que escriben sus ensayos delegando habitualmente todo el trabajo a un asistente de IA.

Los ecos de las conclusiones del artículo han saltado de redes sociales a plataforma de opinión, y de plataforma en plataforma, han llegado a los periódicos, e incluso a la televisión. Las reacciones viscerales, la indignación tecno-optimista y los chistes fáciles que se pueden leer sobre las conclusiones del estudio, explican la obsesión por esta estricta corrección terminológica que reclama todo el tiempo a quien quiera oírlo la autora del estudio:.

Además del vocabulario de la Pregunta 1 evite usar "escáneres cerebrales", "Los LLM te hacen dejar de pensar", "tienen un impacto negativo", "daño cerebral" o "hallazgos aterradores".

Es cierto, que no cunda el pánico. No debería ser necesario insistir en que hay que ser prudentes, que el estudio es limitado y específico, sólo basado en 54 estudiantes universitarios que ejecutan sólo un tipo de tarea: la escritura de ensayos. Pero algunos resultados y las evidencias que los explican son impactantes y, necesariamente, nos alertan de un riesgo.

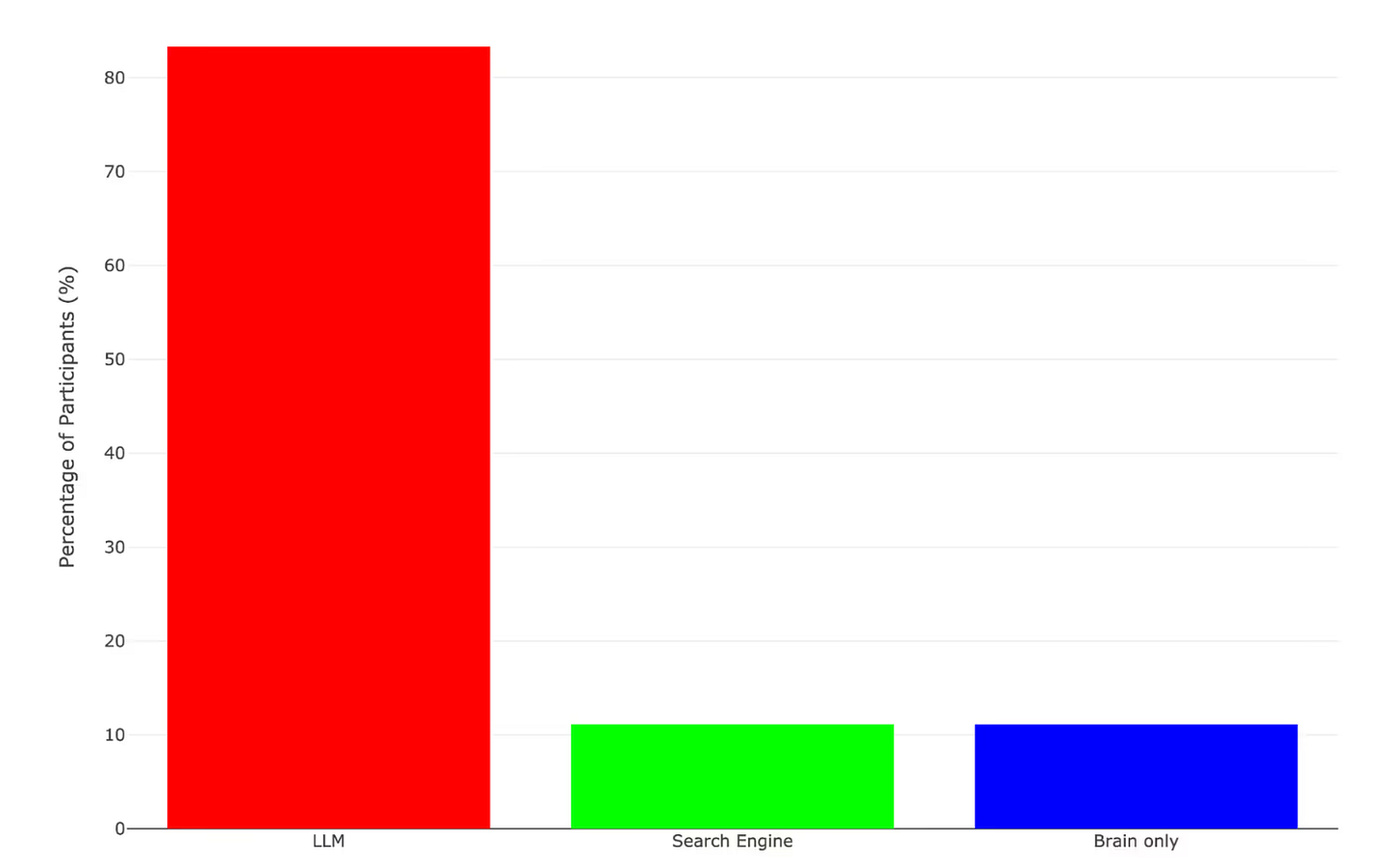

El descubrimiento principal del estudio es que los estudiantes que sólo emplearon - durante 3 sesiones seguidas - la ayuda de LLM para escribir, manifestaron una conectividad cerebral más baja que los estudiantes que utilizaron la búsqueda tradicional - no la enciclopedia, si no el buscador de Google - o los que sólo tuvieron a disposición su cerebro para escribir sus ensayos.

Una baja conectividad cerebral implica la activación menor de capacidades cerebrales como la memoria de trabajo, la atención interna, el procesamiento semántico y el control ejecutivo de la tarea, es decir el manejo y la toma de decisiones sobre los pasos a seguir en el proceso de escritura. Es conocido que todas estas capacidades están vinculadas directamente con la fijación del aprendizaje, con retener lo que se escribe y con haber digerido todo lo que se investiga antes de escribir. Esta falta de fijación del conocimiento la demuestran claramente otros resultados llamativos del estudio.

Los estudiantes que emplearon sólo LLM en sus tareas de escritura, presentaron una casi nula capacidad para citar sus propios trabajos - percepción de autoría - o para profundizar y defender los argumentos empleados en sus ensayos. Igualmente, a medida que se escribían más textos, estos estudiantes tendieron hacia una clara homogeneización lingüística y estilística.

La homogeneización lingüística tiene múltiples causas y es una consecuencia colateral - aunque muy relevante - de lo que más ha impactado del estudio: la aparición de una deuda cognitiva, una pérdida de capacidad y control sobre el aprendizaje.

Inconscientes

El artículo sugiere que las evidencias mostradas en el experimento indican la aparición de cierta atrofia de algunas capacidades cognitivas que resultan relevantes para el proceso de aprendizaje. A largo plazo, la ganancia en efectividad - los estudiantes que sólo empleaban LLM sacaron mejores resultados académicos al principio - esconde la generación de una deuda de aprendizaje, algo así como una menor capacidad para fijar conocimiento a largo plazo - los mismos estudiantes no recordaban sus propios artículos semanas después - y de manejar todo el proceso mental para aprender.

Estaréis de acuerdo conmigo que si perdemos la capacidad de aprender, y además perdemos la propia capacidad de gestionar el proceso de aprendizaje, la probabilidad de convertirnos todos en gilipollas aumenta significativamente.

El abanico de reacciones ha cubierto el espectro habitual. En primer lugar los alarmados-zafios carentes del menor interés, que ya venían diciendo hace tiempo que la tecnología nos hace tontos. Por otro lado, los analistas cautos y correctos, que se fijan en los datos, hacen caso a la prudencia y proponen soluciones. Por último los tecno-optimistas, con el argumento de que la IA no es mala per sé, sino que hay que usarla con cabeza. Como las armas, como la droga.

El argumento principal de este último grupo es que ya hemos vivido situaciones similares y no nos ha ocurrido gran cosa. Que otras tecnologías han aumentado algunas de nuestras capacidades intelectuales a cambio de perder otras que hemos cedido sin que la humanidad se haya convertido en un mayor desastre. Los ejemplos habituales son la calculadora, que ha ampliado nuestra capacidad de hacer cálculos aritméticos; las hojas de cálculo, que nos permiten hacer esos cálculos sobre muchos números a la vez. Con su uso, hemos perdido parte de la capacidad de hacer esos cálculos complejos rápidamente y de memoria, pero hemos ganado muchísima eficiencia en la tarea. Visto en conjunto, el precio que hemos pagado no es para tanto. Ya nadie quiere parecerse a los genios calculadores de la tele de los noventa. Ahora sólo nos parecen unos locos absurdos con mucho tiempo que perder.

Otros ejemplos son el GPS, que ha atrofiado un poco nuestra capacidad de orientación; las búsquedas en Google Search y la wikipedia, que nos han hecho olvidar información fácilmente accesible on-line; el corrector ortográfico, que ha hecho que tiremos los textos sin control que ya se corrigen solos. O Facebook, cuya aportación principal a este tema es que hoy en día se feliciten más cumpleaños que nunca, y sin embargo nadie se acuerde de ninguno.

En todos estos ejemplos hemos cedido algo de capacidad cognitiva a cambio de una capacidad aumentada, una mayor eficiencia en una tarea que requiere un esfuerzo mental. Algunos lo llaman el efecto Google, y está ampliamente analizado con el consenso general de que estas cesiones no nos han convertido en seres acríticos, incapaces de aprender, o de abordar la resolución de un problema.

He llamado al departamento de comunicación de TikTok preguntando qué capacidad aumentan ellos y me han dicho que no saben, que quizás sólo la de volvernos gilipollas [3].

Perezosos

El problema que plantean estos resultados preliminares relacionados con el uso de la IA, es que no parece que sólo estemos ante la nueva versión más potente del efecto Google. De perdurar a largo plazo los efectos observados en el estudio del MIT, no podemos afirmar que estamos sólo ante una extensión lineal de los casos anteriores. El cambio es más profundo.

Las evidencias del bajo compromiso cerebral mostrado en el experimento, indican que estamos ante un efecto distinto, y potencialmente estructural. Por lo que parece, además, luchamos contra un principio de mínimo esfuerzo natural, y los principios de mínimo esfuerzo suelen ser imbatibles. El cerebro tiende de forma natural a buscar su propia eficiencia, y esto amplifica el riesgo de aparición de la deuda cognitiva, y de algún modo nos obliga a invertir energía específica en mitigarlo. Como la energía que deben usar, aquellos que quieren volar.

Cuando se activan los patrones de conexión cerebral vinculados al aprendizaje, se requiere un consumo energético específico para fijar las conexiones de forma eficiente [4]. Cuando estas conexiones se fijan por primera vez el esfuerzo cerebral es grande. Pero a medida que repetimos la tarea, repensamos los conceptos, o practicamos una habilidad cognitiva (hacer cálculos) estos patrones de conectividad encuentran formas de reducir el esfuerzo energético, hasta el punto de automatizar el conocimiento (por ejemplo a la hora de conducir, de orientarnos, de cocinar) y convertirlo en inconsciente. Al final del proceso, somos capaces de utilizar conocimientos complejos sin necesidad de invertir energía, sin prestar apenas atención consciente. Pero, para que esta optimización se materialice, es imprescindible la repetición.

Si empezamos a procesar información con patrones de baja conectividad, a aprender superficialmente o directamente a no aprender, cada vez que queramos retener algo nuevo, cada vez que sí necesitemos activar esas conexiones atrofiadas, nuestro cerebro tendrá que emplear esfuerzo energético importante - cada vez como como la primera vez - al que ya no está acostumbrado. El principio de mínimo esfuerzo, la búsqueda natural hacia la eficiencia del propio cerebro, hará que tendamos a buscar un alternativa satisfactoria de bajo esfuerzo, empujándonos inevitablemente hacia el bucle perezoso, y al uso de la IA.

Sociales

Hay otras situaciones en las que cedemos capacidad de aprendizaje a cambio de alguna contrapartida [5], por necesidad o por conveniencia. Lo he experimentado personalmente, al dirigir equipos que exploran nuevas herramientas y tecnologías para los proyectos que hacemos en GALEO.

Los ingenieros se enfrentan al proceso profundo de explorar alternativas, estudiar y familiarizarse con nuevas herramientas, pelearse con ellas hasta saber integrarlas en nuestras arquitecturas y desarrollos. Mientras tanto, yo voy actualizando mis conocimientos tecnológicos por delegación, a través de sus explicaciones, informes y prototipos. Este es un aprendizaje más superficial, sin duda, pero suficientemente satisfactorio para mí. Conectando las nuevas ideas con mis conocimientos y experiencias previas, puedo integrar cómodamente las novedades en los problemas que debo resolver, y en los conocimientos que debo aprender ahora a medida que cambia mi función, y a las que debo dedicar mi tiempo y mi atención más profunda. A lo largo de este proceso de cambio, sin duda he perdido la agilidad para aprender un lenguaje de programación nuevo, o para manejarme con las las últimas especificaciones de Arduino, y hoy en día me cuesta hacer cualquier tontería con un par de sensores en mi casa.

Imagino que esta situación es similar a cómo aprende cosas nuevas un investigador que dirige varias tesis doctorales, o cómo se actualiza un director de periódico sobre los temas que investigan sus redactores. Todos ellos delegan procesos de aprendizaje en las personas con las que trabajan, mientras desde su posición ponen el foco en aprender, resolver problemas, diseñar soluciones sobre los temas de su responsabilidad.

Esto nos lleva a pensar en el efecto del fenómeno de la deuda cognitiva en las organizaciones. Estos procesos de aprendizaje colectivo que acabo de describir se basan en el hecho de que todos los miembros del grupo están aprendiendo, cada uno en los aspectos específicos de su función, y el aprendizaje colectivo se produce por las conexiones entre sus miembros. No en las conexiones personales o emocionales, sino en las conexiones necesarias para transferir información a la organización, responder preguntas y resolver problemas colectivos, y llevar a cabo actividades y proyectos conjuntos. La organización, colectivamente aprende, fija conocimiento.

Si, por el contrario, el principal interlocutor para obtener información dentro de una comunidad es la IA - puesto que lo sabe todo y mejor que nadie en la organización - podríamos encontrar un patrón de organización que está activada - interactuando con el LLM - pero poco conectada. Si además individualmente esta forma de aprendizaje y de resolución de tareas, implica un bajo compromiso cognitivo individual, tendremos organizaciones eficientes en ejecutar las órdenes y prescripciones de una inteligencia artificial. Pero serán organizaciones incapaces de adquirir nuevo conocimiento, incapacitadas también para ofrecer a sus miembros un conocimiento organizativo diferente al de cualquier otro grupo de personas.

Podríamos continuar la especulación y ampliar la escala desde las organizaciones más pequeñas, departamentos universitarios, empresas y mesas de redacción, a grupos sociales y sociedades enteras. Nadie que no sea gilipollas ya ahora, puede vislumbrar un futuro halagador pensando en sociedades pobladas por individuos sin capacidad de aprender ni manejar su aprendizaje.

Ineficientes

Los analistas más moderados, se han tomado la molestia de buscar escenarios que equilibren el efecto de la deuda cognitiva. La aproximación que proponen es bastante convincente, pero con matices.

Las propuestas pasan por buscar modelos de interacción con la IA - flujos de trabajo, interfaces de usuarios, modelos de entrenamiento - que permitan mantener completamente activadas nuestras capacidades cognitivas más importantes supervisando y planificando el trabajo de la IA, combinando su asistencia con esfuerzos intelectuales basados solo en nuestras capacidades naturales. La promesa de estos modelos es que finalmente la IA sí nos liberará de las tareas más repetitivas y mejorará enormemente nuestra eficiencia. Pero con estas premisas de intervención humana, la IA también nos permitirá mantener el control sobre las funciones intelectuales más elevadas, creativas o de gestión del proceso.

Creo que esto no es suficiente. Si bien no nos importa ser incapaces de hacer raíces cúbicas o de manejar fracciones en cálculos mentales complejos para la mayoría de los casos en pos de la eficiencia, existen situaciones donde la eficiencia no es nuestro objetivo principal. No nos importa sumar con la calculadora en el trabajo, pero sí nos importa prestar atención cuando negociamos la compra de una casa, y nos gustaría hacer números mentalmente y a toda rapidez para sentirnos confiados y conseguir una buena negociación. En esta situación la eficiencia no es lo más importante, lo importante es que no nos timen.

Aunque nos parece razonable que no nos sepamos orientar en una ciudad desconocida, nadie se sentiría a gusto habiendo perdido la capacidad de orientarse en su propio barrio. No me importa no recordar el cumpleaños de la mayoría de mis amigos, pero sí me resultaría triste olvidar la fecha de cumpleaños de mi madre.

Si el riesgo de la deuda cognitiva se materializa a largo plazo, puede que podamos mantener vivas las capacidades cognitivas superiores - diseñar, planificar, etc… - pero hay situaciones donde no sólo queremos ser eficientes, creativos y planificadores, queremos resolver el problema con nuestras propias manos, artesanalmente. Cuando nos la jugamos mucho o nos jugamos algo muy querido, queremos resolver los problemas con conocimiento de causa y con un análisis profundo de las alternativas y opciones. Ante un problema familiar no sólo queremos buscar una solución eficiente, queremos una solución buena y que hayamos tomado con un proceso de reflexión autoconsciente que nos proporcione seguridad.

La deuda cognitiva no es selectiva, no sólo se manifiesta en el trabajo. No sólo se manifestaría en aquellos temas en los que apostamos por la eficiencia - en los temas profesionales por ejemplo - sino que afectaría a nuestras capacidades también cuando no queramos ser eficientes y busquemos otras cualidades en la solución y en el proceso para encontrarla.

Apostarlo todo a la eficiencia significa que nuestro único confort está en ser eficientes, y además solemos vincularlo a nuestra especialización profesional. Apostarlo todo a la eficiencia es asumir que somos básicamente seres funcionales que deben aspirar a mejorar su rendimiento. Pero nuestras comunidades se sustentan en muchas cosas más allá de la eficiencia, y para ello necesitan otros aspectos de nuestras capacidades.

Creo que es necesario que aprendamos a distinguir de qué forma la IA nos hace personas con capacidades aumentadas, y cuándo se convierte en una sustancia dopante. El estado de sobreproducción derivado del dopaje no es sostenible, mientras que por capacidades aumentadas todos asumimos una integración armónica del refuerzo en nuestra naturaleza y actividades. El dopaje produce máquinas especializadas, pensadas para rendir al máximo en condiciones determinadas y con funciones específicas. A menudo inhábiles para funciones diferentes. Incluso deterioradas por la hiper-especialización.

Si la IA resultase ser doping puro y duro para nosotros, podríamos imaginarnos como máquinas funcionalmente super eficientes en tareas complejas y muy especializadas, y prácticamente inhábiles para cualquier circunstancia vital que se aleje de nuestro punto de máximo rendimiento. Puede parecer un escenario de máxima excitación y foco, una noche de whisky con RedBull. Pero me temo que el dopaje de la IA se parece más a un relajante muscular que nos puede dejar, esta vez sí, acríticos y adormecidos.

Los hijos de Sam Altman

¿Cómo podemos evitarlo? Sólo se me ocurre que nos puede librar de este riesgo nuestro amor por aprender, nuestro gusto por conocer, por nuestro pulso natural a entender y transformar el entorno. Características que, por cierto, también son intrínsecas a la naturaleza humana desde el comienzo de los días, aunque no sean las más populares en los vídeos de TikTok.

De la misma manera algunas organizaciones tomarán consciencia de la importancia de su propio aprendizaje colectivo, y no dejarán que se escape todo por el agujero de la eficiencia. Pero otras sí, otras no perderán un minuto en lamentar que todos sus empleados sean medio gilipollas si el EBITDA puede subir un par de puntos.

Dice Sam Altman [6] que sus hijos son la primera generación que crecerá con máquinas más inteligentes que ellos. No sé exactamente qué consecuencias imagina, pero me intriga pensar cómo se aprende a aprender y a valorar la importancia de aprender y fijar conocimientos con un asistente que los sabe todo, nos da todas las respuestas y resuelve todas nuestras dudas.

En el estudio del MIT, los estudiantes que habían tenido que usar sólo el cerebro para los escritos del experimentos, mostraron una conectividad neuronal normal cuando - al final de la serie de sesiones - les permitieron usar la ayuda de un agente LLM. Quizás aquí esté un indicio, quizás la pregunta sea ¿cuántos problemas deben resolver como primates los hijos de Sam Altman antes de poder usar la IA?

Perdón por las palabrotas.

Así que sí. Cuidado con la IA que puede convertirte en gilipollas. Aunque ahora no lo seas.

Puede que seas una persona culta, autocrítica, consciente de tu proceso de aprendizaje y trabajo creativo. Pero si no lo cuidas, si no lo ejercitas por la ambición de convertirte en un superhombre en el trabajo, es muy probable que la IA también te convierta en gilipollas.

Perdón por la palabra. Perdón por repetirla. Perdón por el alarmismo. Perdón porque este post, al fin y al cabo, ha sido escrito con la ayuda de la IA.

El making off.

Este post ha sido creado con la ayuda de Gemini. Puedes encontrar toda la información sobre el proceso de creación de este post en este link.

Referencias.

[1] https://www.brainonllm.com/faq

[2] Koshima et al, “Your Brain on ChatGPT: Accumulation of Cognitive Debt when Using an AI Assistant for Essay Writing Task”, 2025.

[3] What happens to your brain when you watch videos online at faster speeds than normal, The Conversation, 2024

[4] Oguzhan Polatt, Cognitive Economy: The Brain’s Journey from Effort to Automation, Medium, 2024.

[5] En realidad es una parte intrínseca de nuestra condición de seres sociales. H..A. Simon, The science of the artificial, 1968.

[6] https://computerhoy.20minutos.es/tecnologia/sam-altman-sentencia-futuras-generaciones-hijos-ya-no-seran-listos-ia-1468115

Machining the Ghost, una charla sobre el proceso creativo y las interacciones con la IA, del matemático Dan Rockmore, Sante Fe Institute. Apunta a la oportunidad de aumentarnos con la IA en el proceso creativo, con la dialectica, en la interacción y el cuestionamiento entre el humano y la IA.

https://www.youtube.com/watch?v=w2al0jNTDC8